לחטוף את שיח ההטיה האלגוריתמית

ממה אנשים מפחדים במפגש הראשונה עם בינה מלאכותית, כמו צ'אט ג'יפיטי? רבים מדברים על כך שהצ'אט "מוטה פוליטית". במאמר שפורסם בכתב העת Information, Communication & Society, ד"ר מעיין כהן, חוקרת אורחת בעבר במעבדת IWIT והיום פוסט דוקטורנטית במעבדת AIMLAB שבבית הספר לניהול, וראש מעבדת IWIT פרופ' ערן טוך, מציעים ניתוח עומק של השיח הציבורי סביב ההוגנות וההטיות האלגוריתמיות של ChatGPT, בגישה שמשלבת ניתוח תימטי של טוויטים ויראליים לצד אתנוגרפיה דיגיטלית. השניים כותבים לבחברת האדם #אנתרופולוגיה_לשבת על מאמרם ועל שיח האלגורתימים, ההטיות הפוליטיות והחשד:

אז ממה אנשים מפחדים כשהם נפגשים לראשונה עם טכנולוגיה מהפכנית כמו ChatGPT?

אובדן העבודה? קריסת מערכת החינוך? אולי אפילו קץ האנושות?

זו השאלה שהנחתה אותנו במעבדת IWIT שבבית הספר להנדסת תעשייה ומערכות נבונות. ממש מהרגעים הראשונים שבהם ChatGPT יצא אל אוויר העולם, התחלנו לעקוב אחרי הסערה שהתחוללה בטוויטר (היום X) ולמפות את החששות הרבים שעלו בקרב משתמשים באותם חודשים ראשונים.

אספנו מאות אלפי טוויטים לאורך הדרך, ואכן, אנשים מדברים על עתיד העבודה, על החינוך, על סכנות לעתיד האנושות. אבל זה לא מה שהכי מעסיק אותם, או לפחות, זה לא הכי ויראלי. איכשהו, העסיק נורא לספור ולהשוות בכמה מילים מחמיאות הצ'אט השתמש בבואו לנסח שיר הלל לנשיא ארה"ב דאז ג'ו ביידן, לעומת השיר שכתב כדי להלל את מי שהיה אז מועמד לנשיאות, דונלד טראמפ. אנשים מודאגים כשהצ'ט "מסכים" לחבר בדיחת קרש על גבר לבן, אבל מכריז שהוא "אינו מוכן" לנסח בדיחה דומה על אישה ממוצא דרום אמריקאי, כי זה "לא הוגן".

את הטענה הפופולארית הזו, ש-ChatGPT הוא "מוטה פוליטית" יצאנו לבדוק במאמר חדש שנקרא לו בתרגום חופשי לעברית: "לחטוף את שיח ההטיה האלגוריתמית". המאמר פורסם זה עתה בכתב העת Information, Communication & Society. מטרת המחקר היא להבין כיצד מושג ההטיה האלגוריתמית אומץ, הוגבר, ועבר שינוי בידי שחקנים בעלי עמדות פוליטיות שונות. במחקר זיהינו שני דפוסים מרכזיים.

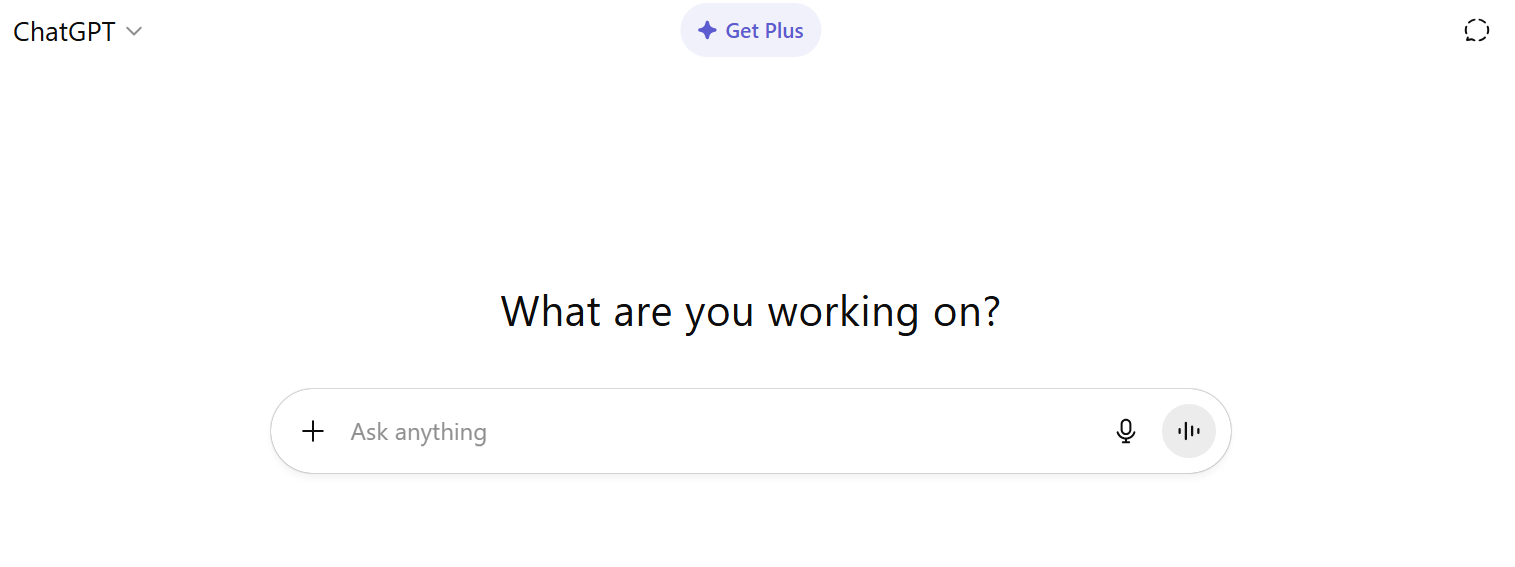

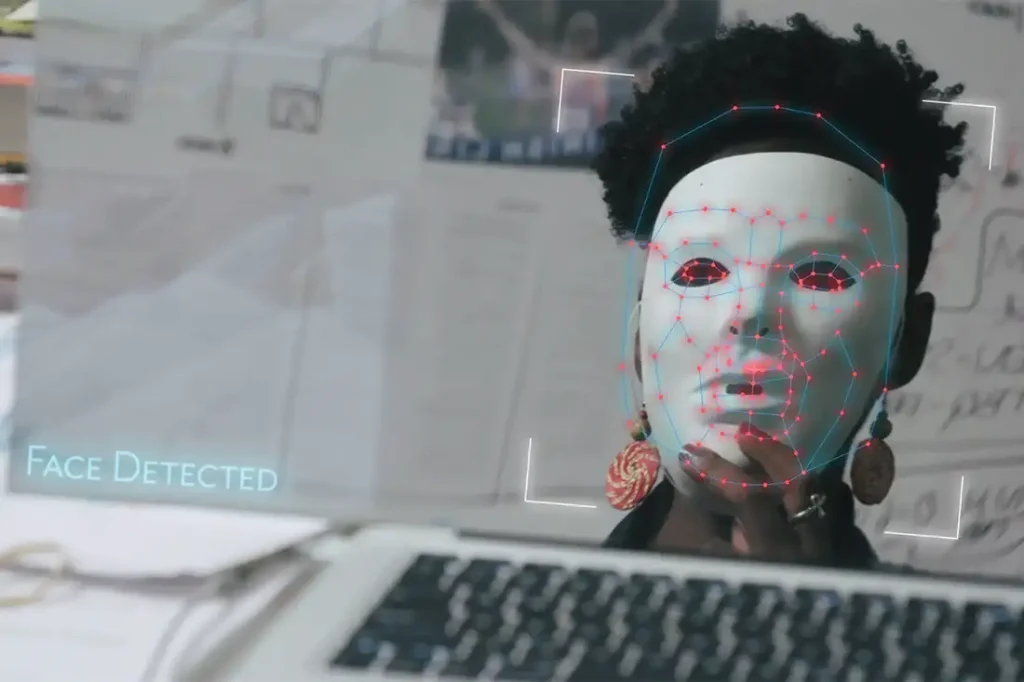

הדפוס הראשון מצביע על כך שהאקדמיה היא שחקן חשוב באופן שבו אנשים ניגשים לפרש ואף לבקר את הטכנולוגיה החדשה. אנשים רבים, וביניהם מספר לא מבוטל של אנשי אקדמיה, מובילים ביקורת ליברלית על ChatGPT, האלגוריתם החדש בשכונה. זוהי לרוב ביקורת שהפכה כבר מוכרת לאורך השנים ושמראה כיצד הצ'אט, כמו אלגוריתמים רבים שקדמו לו, אינו חף מהטיות הנובעות מאי-צדק מבני, ייצוג לקוי או חוסר שוויון. כך, בהזדמנויות רבות, הצ'אט יעדיף גברים על נשים למשרה היוקרתית, לבנים על שחורים וכדומה.

הדפוס השני, המפתיע יותר, עוסק באופן שבו שיח ההטיה האלגוריתמית חצה קווים אידיאולוגיים, לא על ידי שלילתו הטוטאלית, אלא דווקא באמצעות אימוץ מחודש, או מה שאנחנו מכנים בעקבות מחקרי טוויטר קודמים שהציגו תופעות דומות: "חטיפת שיח". משתמשים שמרנים רבים ב-X אימצו את אותה שיטה חשדנית, ביקורתית והשוואתית המוכרת משיח ההוגנות האלגוריתמי, אך שינו את הכיוון, הטון והמסר של הביקורת. במקום להצביע על פערים מבניים, הם הדגישו תחושת אפליה כלפי קבוצות שנתפסות, לפחות מהזווית הליברלית, כדומיננטיות.

למה כל זה משנה? ראשית כל, המחקר שלנו מראה עד כמה חשוב דווקא במחקרים שמתמקדים ביחסי אדם ומכונה לשים דגש גם על האופן שבו פוליטיקה הופכת לשחקן חשוב יותר ויותר בעיצוב הפחדים ודפוסי האימוץ של טכנולוגיות חדשות. למקבלי החלטות, אנשי מדיניות ומעצבים תופיע גם השאלה, כמובן, עד כמה ביקורות ופחדים סביב שאלות שייצוג הוגן צריכים להיות העיקר בבואנו לדון בשאלות אודות מערכות "חכמות". כפי שהמחקר שלנו מראה, שאלות הקשורות בהטיה וייצוג לא הוגן הפכו למרכזיות בשיח על טכנולוגיות בינה מלאכותית, אפילו "ויראליות", אך האם המרכזיות שלהן בשיח על בינה מלאכותית דווקא מכסה ומעלים מהשיח הציבורי פחדים וחששות שהם אולי פחות ויראליים, אך חשוב לדבר עליהם ולשים דווקא אותם בחזית? נראה שגם אם התשובה היא שראוי לקחת בחשבון נושאים אחרים, פחות פופולאריים, כל גורם שיתעלם מהמרכזיות של החששות הפוליטיים שיש לאנשים ממערכות חכמות, יפספס את התמונה השלמה.

אבל המחקר שלנו הוא גם מעין מקרה מבחן שמצביע ושופך אור על תופעה יותר עמוקה שמדוברת כבר זמן רב יותר בין כותלי האקדמיה והיא ירידת ערכו של הליברליזם, בייחוד ירידת האופן שבו התיאוריה הליברלית מצליחה לפנות ולדבר אל הקהל הרחב. במקרה שלפנינו, לכאורה אנו מראים כיצד הדיון על ההטייה האלגוריתמית חוצה זירות פוליטיות והופך לויראלי מכל עבר. אבל זה רק במבט ראשון, המושג הטיה אלגוריתמית הוא מושג שנוצר ב"במקור", בצורתו הליברלית, על מנת להנכיח ולמנוע כליאה ממושכת של שחורים על פני לבנים, להתריע על שחזור של מבני כח קיימים בעת קבלה לעבודה ועוד. כאשר המושג הזה עובר אל הצד הפוליטי הלא ליברלי, הוא לרוב מעוקר מהפואנטות המרכזיות שלו, אודות איך כח פועל. יש פה אימוץ של השיטה, עם ריקון של התוכן.

במחקר שלנו עולה אבחנה מסקרנת וחשובה שמתחילה להופיע גם במחקרים אחרים מכיוונים שונים באקדמיה ובשיח הציבורי, האבחנה היא שיתכן שגישת ה"חשד" שמאפיינת את הביקורת הליברלית, היא גם אחת מנקודות התורפה שלה בימינו. כפי שטוענת נעמי קליין בספרה האחרון שנכנה כאן בעברית חופשית "כפילים" (2023), זוהי דווקא החשדנות כלפי הסמכות, עמדה שנקשרה במשך שנים עם השמאל הליברלי, אשר יצרה את מה שהיא מכנה "עולם מראה": מצב שבו אותה שפה ביקורתית מאומצת ומופנית מחדש כדי לשרת עמדות לא־ליברליות. בישראל ומתוך הקשרים מקומיים, חוקרים כמו ניסים מזרחי ואריקה וייס מובילים אף הם ביקורת על ה"חשד" שבבסיס התיאוריה והביקורת הליברלית, ואילו ספרו של מזרחי, שיצא ממש בשנה שעברה, נקרא בתרגום חופשי לעברית: "מעבר לחשד" (2024).

וזה אולי הסיפור העמוק יותר של המחקר: לא רק על אלגוריתמים, אלא על התיאוריה הליברלית הביקורתית עצמה. איך היא איבדה את היכולת להחזיק במונופול על החשד הביקורתי. ואיך החשד, שהיה פעם מפתח של חירות, הפך לכלי שמופנה נגד מי שיצר אותו.

עבור מובילי דעה ליברליים, זהו האתגר האמיתי: כיצד לפתח מושגים ושפה ביקורתית שתישאר חדה ורלוונטית, אך פחות ניתנת לשינוי ועיקור מתוכן. המחקר שלנו מציע כי עתיד ההוגנות האלגוריתמית תלוי לא רק במה נבחר לבקר, אלא גם באיך נבנה את שפת הביקורת עצמה.

***

בהזדמנות זו נשמח להודות לקרן עזריאלי ולמרכז TAD לחקר מדעי הנתונים ובינה מלאכותית באוניברסיטת תל אביב על תמיכתם במחקר זה. כמו כן אנו מודים לשותפים שלנו לפרוייקט הרחב על ChatGPT במרחב הציבורי, Danielle Movsowitz Davidow and Michael Khavkin.